众所周知,阿联酋在科技及教育产业方面投入的预算一直不菲,近日,阿联酋科技创新研究所(TII)打造出了 400 亿参数的语言模型 Falcon-40B,在 Hugging Face 的 OpenLLM 排行榜上排名第一,并持续霸榜,赢过此前 LLaMA、StableLM 和 RedPajama 等竞争者。

图源 阿联酋科技创新研究所(TII)

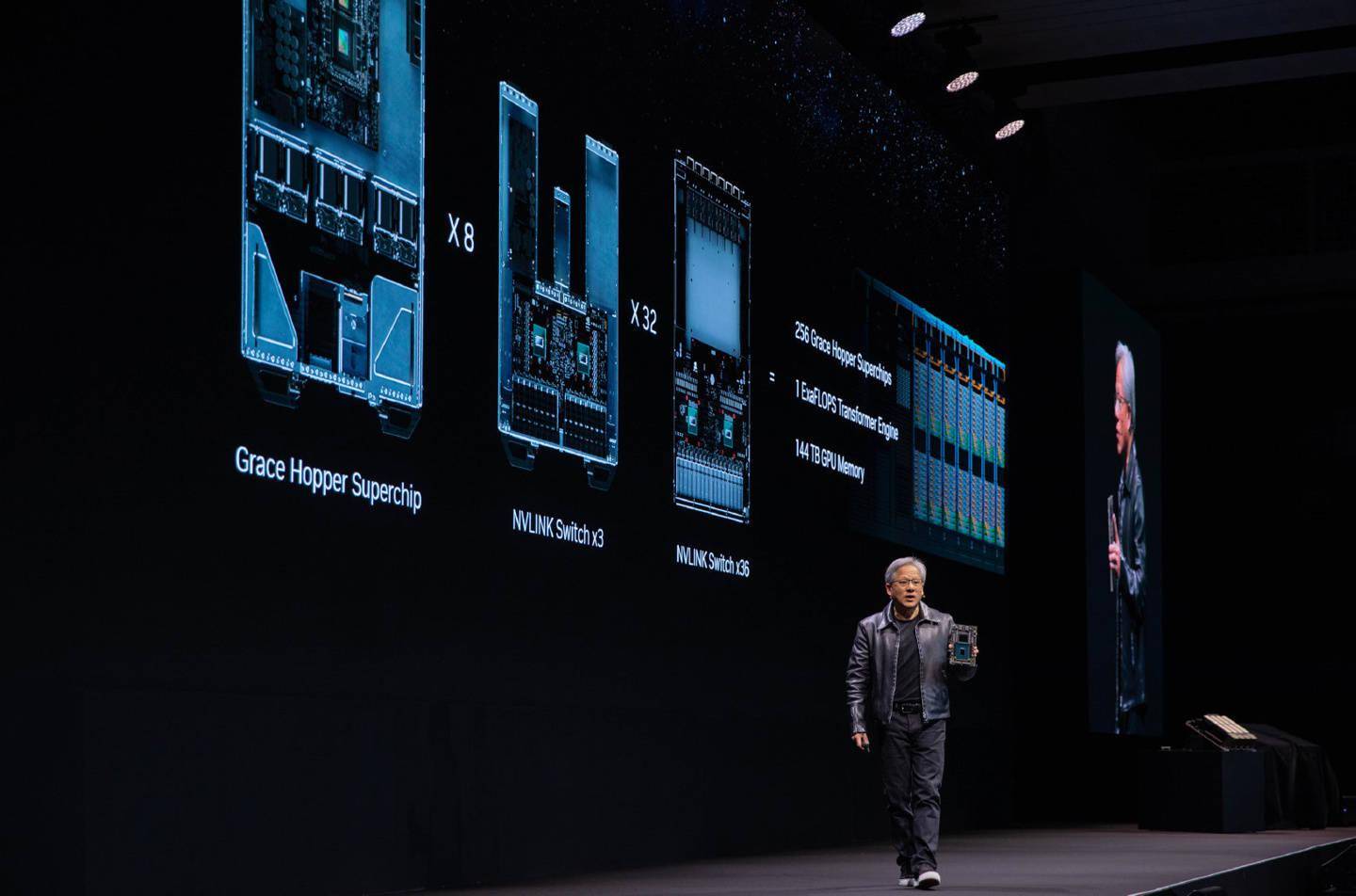

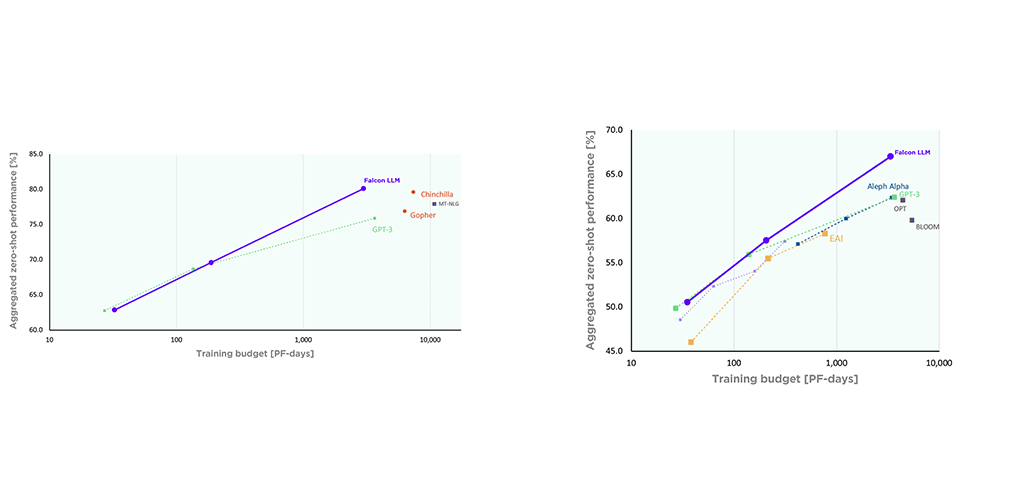

据称,Falcon-40B 使用了 384 颗 GPU 来进行 2 个月的训练、利用将近 5 亿个 Token 训练而成。为提高训练过程的质量,团队还自己组建了一套工作流程来筛选出“最高质量的的资料”供给 AI 模型训练。经多个基准测试,表现比 LLaMA、Vicuna 和 Alpaca 更加出色。

此外,团队还采用了“多重查询注意力”(Multiqery attention)机制,来提高模型的效率。“多重查询注意力”机制即模型可以对每个 Token 进行多个查询,来更好表示同一序列中,不同 token 之间的关系,以在加速模型运算效率的同时,降低模型的复杂性,进而提高模型整体的可维护性。

阿联酋科技创新研究所首席执行官 Ray O. Johnson 博士表示:“2023 年将是人工智能之年。Falcon 模型对我们来说具有里程碑意义,但这仅仅是个开始”。

注意到,Falcon 模型已经在 huggingface 上开源,目前开源的版本有 Falcon-7B-Instruct 和 Falcon-40B-Instruct 等。